概要

本作品は、音と色の関係、そして共感覚の一種である「色調」(音を聞くと反射的に色を想起する現象)をテーマに制作した、電子音楽・ライブコーディング・流動的なビジュアルが融合するパフォーマンスである。作者自身の、音に対する色のイメージを学習したAIに、電子音楽の演奏を聞かせ、AIが導き出した色を映像やLEDでリアルタイムに可視化した。2025年1月と4月にドイツ・アーヘン工科大学で本作品を発表し、学生や研究者とAIとアートの可能性について意見を交わした。

プロジェクト実施協力:原 正彦 (東京科学大学 名誉教授、環境・社会理工学院 特別研究員)

作品の背景と目的

本作品は、音と色の関係性に着目し、音から色を予測するAIシステムと、それをリアルタイムの音楽演奏および映像演出に応用する試みである。特に、人工知能に共感覚のような知覚を持たせることへの興味から、音を入力するとAIが対応する色を提示するシステムを構築することを目的とした。

アーティストが自身の知覚や感覚を鑑賞者と共有することがアートの役割の一つであるとすれば、「自分が音を聴いた時に反射的にイメージする色」を他者と共有できる仕組みが存在する意義は大きい。本作品『Melodic Pigments: Exploring New Synesthesia』は、そのような共有を可能にする表現手法の実践を試みたものである。

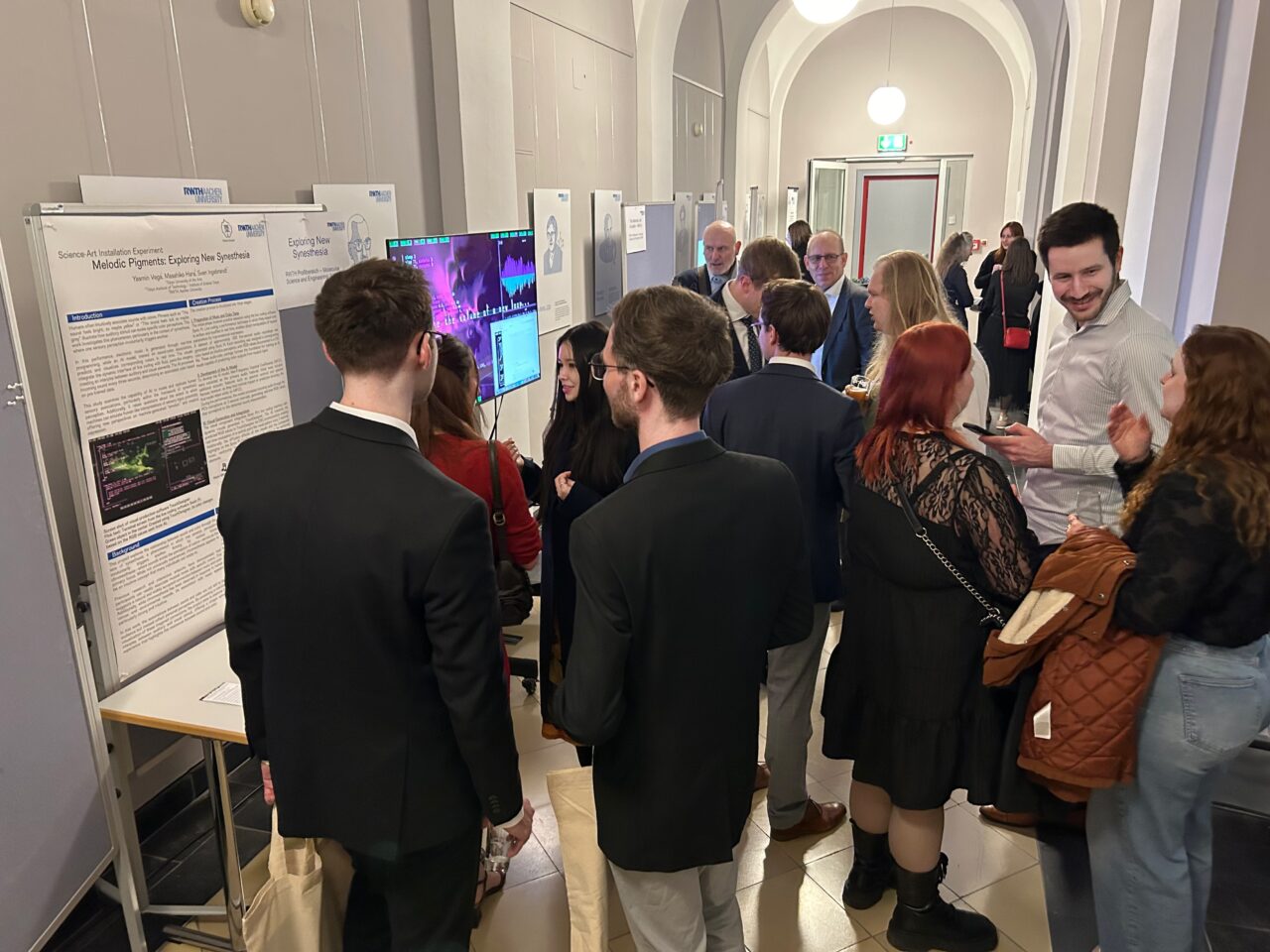

2025年1月および4月にドイツ・アーヘン工科大学(RWTH Aachen University)にて本作品を発表した。アーヘン工科大学では、科学に関係する作品を制作するアーティストを招聘することで、科学者に新たな視点や感性を取り込む試みを行っており、今回の発表もその一環として受け入れられた。現地では研究者や学生との意見交換を行い、科学と芸術の融合に関する多様なフィードバックを得る貴重な機会となった。

作品制作過程

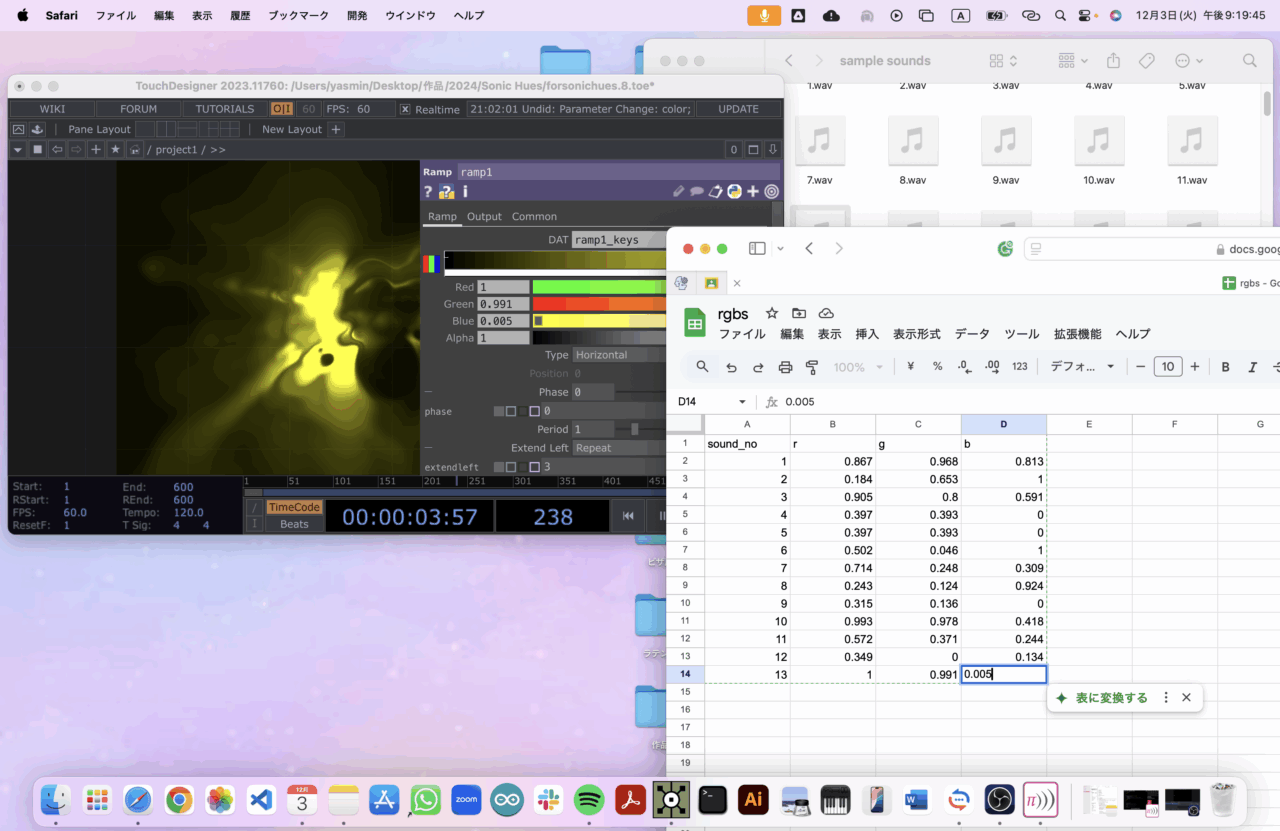

1. 音声データの準備

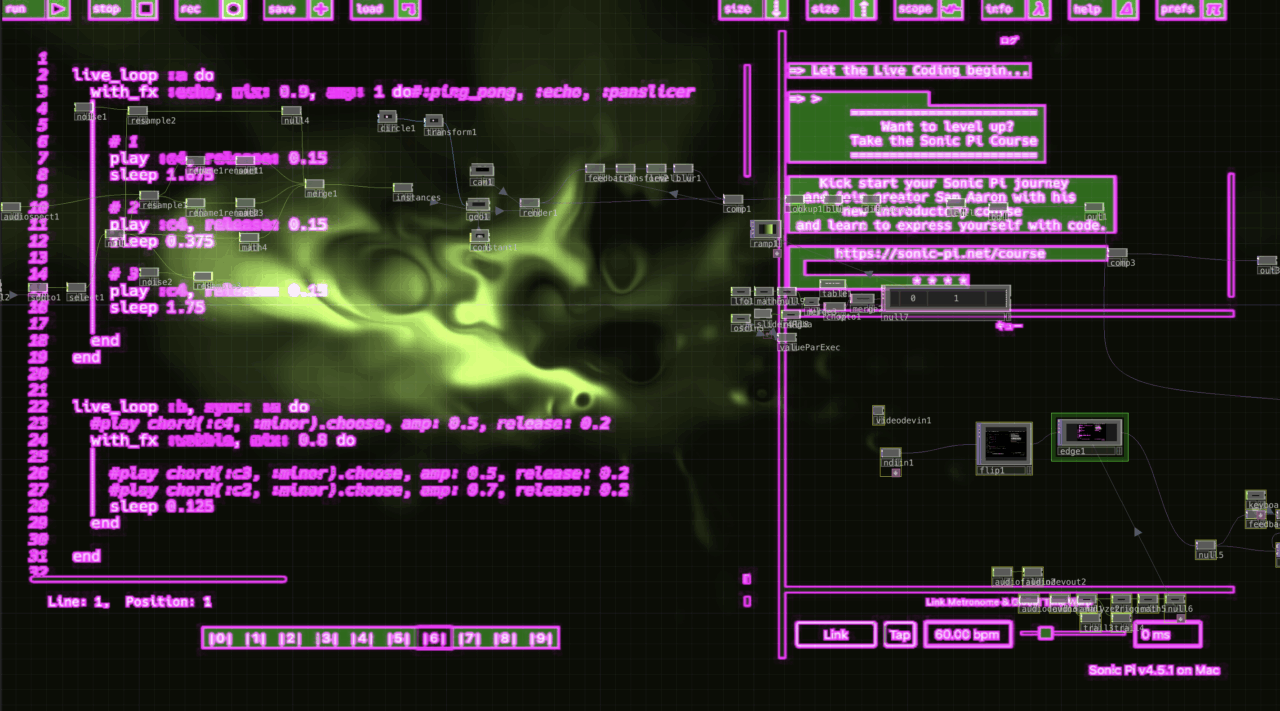

本作品では、パフォーマンス時の演奏にSonic Piというライブコーディング用の音楽作成ツールを使用している。ライブコーディングとは、プログラミングをしながらその場で音楽(主に電子音楽)を生成し、即興演奏する方法である。私が演奏時によく用いるループ、エフェクト、サンプリング音源などをSonic Piから録音し、3秒程度の短い音声データを約300個作成した。

2. 色データの準備

各音声ファイルに対し、私がイメージする色をRGB値で記録したCSVファイルを作成した。

3. AIモデルの開発

1と2で準備した音声データと色データを用いてAIモデルを構築し、任意の音声を聴かせると、その音に対して私がイメージするであろう色のRGB値予測を3秒ごとに出力するシステムを完成させた。

具体的には、音声の特徴量としてMFCCを抽出し、平均値をとって20次元の特徴ベクトルとして整形した後、ニューラルネットワークに入力した。モデルはKerasで構築した全結合型のフィードフォワードニューラルネットワークであり、以下のような構成となっている。

- 入力層: 20次元(MFCCの平均値ベクトル)

- 隠れ層1: 128ユニット、活性化関数ReLU

- 隠れ層2: 64ユニット、活性化関数ReLU

- 隠れ層3: 32ユニット、活性化関数ReLU

- 出力層: 3ユニット、活性化関数sigmoid(RGB値を0〜1の範囲で出力)

4. 映像部分の制作

映像表現にはTouchDesignerという映像制作ソフトを用いた。Sonic Piの操作画面に加え、インクが上から落ちてくるような視覚的演出を制作した。このインクの色には、演奏中に実行されるAIシステムが出力したRGB値をリアルタイムで反映させている。

展示概要

- 2025年1月

アーヘン工科大学キャンパス内・Super C にて展示・ポスター発表。

学生からの印象に残る質問「出来上がったAIが、理解不能な動きをしたか。もしする場合、その動きは作品の中で喜ばしい動作か」

- 2025年3月

ART DX EXPO #2 (東京藝術大学 上野キャンパス)にて発表。

パフォーマンス後に20分程度のアフタートークを実施した。アーヘンでの発表において現地協力者として尽力いただいた原正彦氏(東京科学大学 名誉教授、環境・社会理工学院 特別研究員)と、アーティストの諏訪葵氏をゲストに迎えた。

- 2025年4月

アーヘン工科大学 Käte Hamburger Kolleg (KHK)にて発表。

算出されたRGB値をLED照明にも反映させ、空間全体がその色彩に染まるような没入的体験を実現した。

インタビュー記事: https://khk.rwth-aachen.de/melodic-pigments-an-experiment-on-the-relationship-between-sound-and-color/

当初の構想からの変更

当初の構想では、AIが予測した色のインクを水槽に滴下していく演出を計画していた。しかし、パフォーマンス中はライブコーディング演奏に集中する必要があったこと、インク排出装置の自作には高い技術的課題が伴うこと、さらに完成後の機材をドイツへ運搬する物理的負担などを考慮し、このアイデアは見送ることにした。代替案として、AIによる色の出力をリアルタイム映像とLED照明に反映する形式とし、視覚的効果を演出した。

今後の展望

作成した音声データは300件と少ない数ではあるが、それでも私が思い描く色に近い出力結果が多く見られた。今回は電子音楽に限定したが、今後は他の音楽ジャンルや環境音にも対応できるようなデータセットの構築が望まれる。ただ、世の中にはあまりにも多様な音が存在しており、それらすべてを包括的に扱うことには限界もある。

また、本作品は私個人の共感覚に基づいた音と色の対応をベースとしているが、今後は他者、特に鑑賞者の感覚を取り込むインタラクティブな展開を構想している。観客自身が「音が色に変わる」体験に主体的に参加することで、共感覚的な近くの幅がより多くの人に開かれ、多様な感じ方や解釈が生まれることが期待される。

- 山下ヤスミン姫名乃 (Yasmin Vega)

-

共感覚、AI、色と音の関係についてをテーマにメディアアート、デジタルアート、映像等を制作する。

東京藝術大学音楽学部音楽環境創造科4年次在籍。